Más de 200 millones de personas usamos herramientas de inteligencia artificial (IA para los amigos). Uno de estos seres humanos es el investigador y profesor Christian Velasco-Gallego que, lejos de usarlas como un pollo sin cabeza, las ha ceñido a un método claro, con un sentido común necesario y con un humor alejado de postureos en el libro ¿Y si la IA me arregla la vida? Manual práctico para aprovechar la inteligencia artificial sin venderle tu alma a los algoritmos (Libros Cúpula).

Esta “guía irreverente, práctica y divertida para aprender a usar la inteligencia artificial generativa en tu día a día sin volverte loco… ni programador” está dirigida al común de los mortales, “a personas reales, con trabajos reales, problemas reales… y ganas de que alguien –o algo– les eche una mano sin pedirles un máster a cambio”.

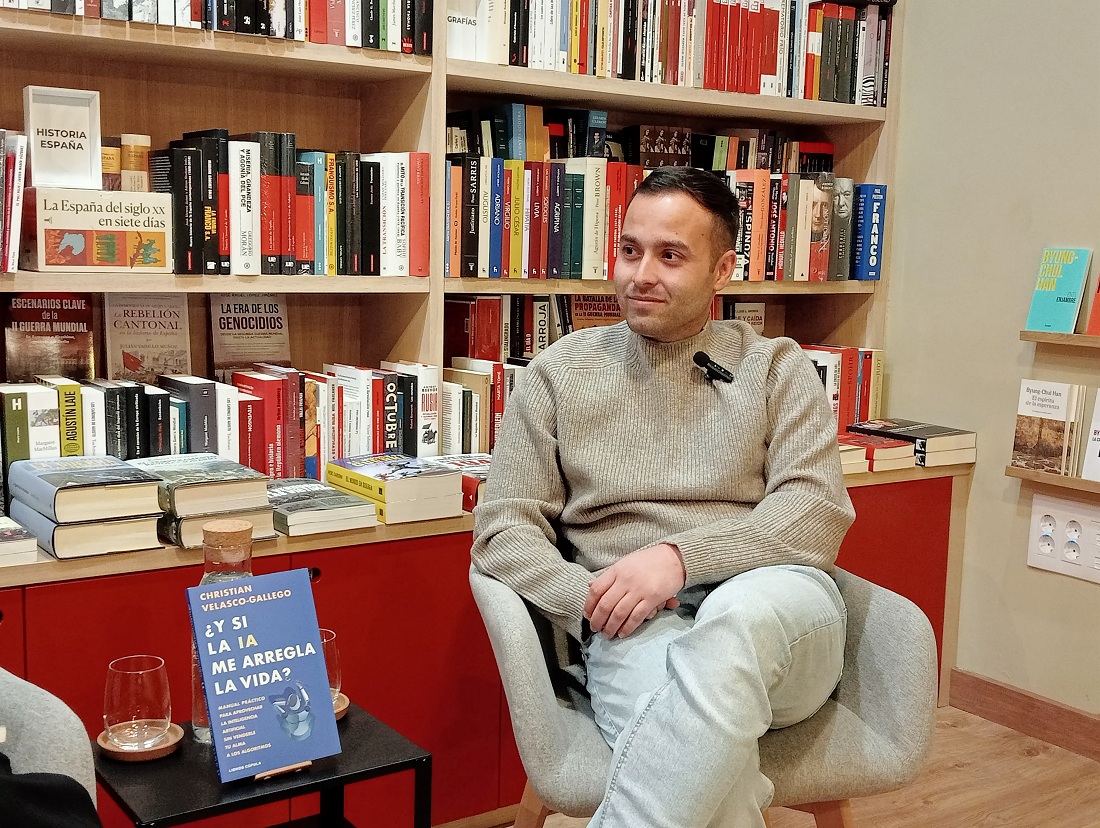

Christian Velasco-Gallego y su criatura van de la mano a librerías y otros espacios para presentar esta tentativa de extraer el máximo potencial a ChatGPT y demás cachivaches tecnológicos. En Espacio Dickynson, en una tarde otoñal, citó a propios y extraños para hablar de cómo los investigadores con este tipo de iniciativas intentan llegar a la sociedad, de qué manera nos liamos nosotros mismos la vida y luego le echamos la culpa a la IA, y del problema de humanizar una IA con “la falsa sensación o creencia de que empatiza con nosotros, cuando es solo un modelo que aprende a través de unos datos”.

Christian Velasco-Gallego (Reus, 1996) es graduado en ingeniería en sistemas y tecnología naval por la Universitat Politècnica de Catalunya, graduado en informática por la Universitat Oberta de Catalunya y doctor en arquitectura naval e ingeniería marina y oceánica por la University of Strathclyde (Glasgow, Escocia). Actualmente es profesor de inteligencia artificial e investigador del Grupo de Investigación Aplicada en Ingeniería y Ciencias de la Computación (ARIES). Le encanta escribir, sacar fotografía y vídeos, pintar acuarelas y escuchar música, entre otros pecados creativos.

Vamos al lío.

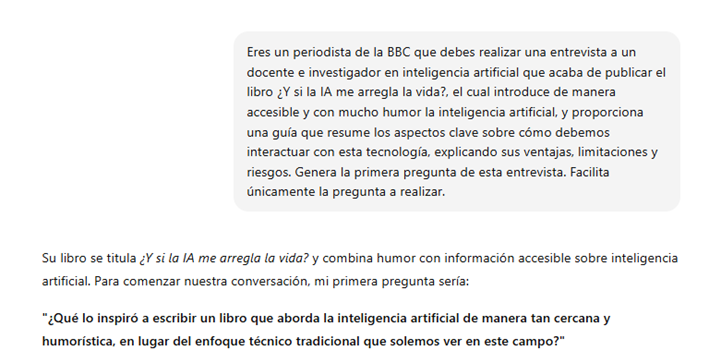

Pregunta: La inteligencia artificial generativa y su interacción con ella le van a hacer la primera pregunta. ¿Cuál sería el prompt (instrucción) ideal para plantear esa primera cuestión? Ponga en práctica las recomendaciones de su manual como si fuera un periodista de la BBC y ponga aquí qué pregunta le ha aconsejado.

Respuesta: Para generar el prompt voy a hacer uso del método de OCA a OCA y del decálogo del buen promptista que indico en el libro. Para ello, primero, uso el concepto de OCA para definir el Objetivo, Contexto y Acción.

Objetivo: realizar una entrevista

Contexto. La entrevista se realiza a un docente e investigador en inteligencia artificial que acaba de publicar el libro ¿Y si la IA me arregla la vida?, el cual introduce de manera accesible y con mucho humor la inteligencia artificial, y proporciona una guía que resume los aspectos clave sobre cómo debemos interactuar con esta tecnología, explicando sus ventajas, limitaciones y riesgos.

Acción: genera la primera pregunta de esta entrevista. Facilita únicamente esa pregunta.

Una vez aplicado el método OCA, podemos complementar el prompt haciendo uso del decálogo del buen promptista y, por ejemplo, añadir un rol específico, pues queremos que la entrevista sea realizada como si el entrevistador fuese un periodista de la BBC.

Rol: periodista de la BBC.

De aquí, podríamos obtener un prompt inicial que nos pueda ser útil para generar esta primera pregunta:

Eres un periodista de la BBC que debes realizar una entrevista a un docente e investigador en inteligencia artificial que acaba de publicar el libro ¿Y si la IA me arregla la vida?, el cual introduce de manera accesible y con mucho humor la inteligencia artificial, y proporciona una guía que resume los aspectos clave sobre cómo debemos interactuar con esta tecnología, explicando sus ventajas, limitaciones y riesgos. Genera la primera pregunta de esta entrevista. Facilita únicamente la pregunta que va a realizarse.

Pregunta que va a realizarse:

¿Qué lo inspiró a escribir un libro que aborda la inteligencia artificial de manera tan cercana y humorística, en lugar del enfoque técnico tradicional que solemos ver en este campo?

P: Conteste a esa pregunta generada por la IA.

R: Lo cierto es que, inicialmente, quería escribir un libro mucho más técnico de lo que había planteado. No obstante, pronto me di cuenta de que ya existían varios libros de ese estilo y, por lo tanto, era muy probable que el que tenía en mente no aportara tanto valor como esperaba. Además, por mi experiencia, cuando explico conceptos similares a los que introduzco en este libro de manera demasiado técnica, las personas que no son del área de conocimiento suelen desconectar por completo al instante, provocando un efecto contrario al que buscaba. De hecho, es al incorporar un poco de humor cuando consigo captar la atención en la mayoría de los casos. De ahí surgió la decisión de crear un libro con mucho humor y un contenido lo más simple posible, con el fin de llegar al mayor número de personas, independientemente de su especialidad.

P: Voy a trabajar un poco… ¿Ha cambiado mucho su vida en el día a día con estas herramientas disruptivas?, ¿en qué aspectos concretos?

R: Ya que menciona que va a trabajar un poco, le lanzo yo una pregunta: ¿podría haberme hecho esta entrevista una herramienta de inteligencia artificial generativa en su totalidad?

P: Hacerla podría hacerla, pero no sería lo mismo…

R: En cuanto a su pregunta, sí, sin duda estas herramientas han transformado mi día a día, aunque principalmente en mi entorno laboral. Considero que, desde que las empleo, soy mucho más productivo e incluso he mejorado la calidad de los trabajos que entrego. También las utilizo, aunque en menor medida, para cuestiones como la alimentación (para modificar una receta en base a los ingredientes que tengo disponibles), el ejercicio físico (para generar rutinas de ejercicios) o la organización de viajes (para que me sugiera posibles itinerarios).

P: Comenta que el diseño del prompt es clave, ¿este es el quid de la cuestión? No quiero destripar su decálogo del buen promptista ni tampoco su método de OCA a OCA, pero a lo mejor puede dar algún apunte…

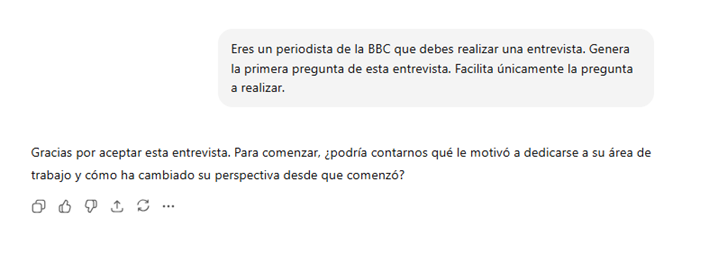

R: Aunque hay otros factores que afectan el desarrollo de la respuesta proporcionada por estas herramientas, lo cierto es que considero que el prompt es un factor clave en ciertas tareas que queremos realizar. Para justificar esto, más que dar alguna observación, lo que voy a pedirle a usted y al lector de este artículo es que experimenten con el prompt que indiqué en la primera pregunta. Por ejemplo, ¿qué pasa si le quito todo el contexto? ¿O si cambio el rol del entrevistador?

Por si no pueden realizar esta prueba en este momento, les muestro un ejemplo. En él, simplemente he tomado el prompt anterior y he eliminado todo el contexto. La pregunta que genera en este caso es la siguiente:

Gracias por aceptar esta entrevista. Para comenzar, ¿podría contarnos qué le motivó a dedicarse a su área de trabajo y cómo ha cambiado su perspectiva desde que comenzó?

¿Qué creen que empeora o mejora? En mi opinión, empeora, ya que se ve claramente que es una pregunta genérica que no aporta valor a la conversación que podemos mantener en relación con el libro.

P: Por otro lado, el libro me ha hecho reflexionar sobre eso de “no tener miedo a escribir párrafos” en las instrucciones que le damos a la maquinita. Ocurre lo contrario a las búsquedas en internet, que somos tacaños con las palabras…

R: Creo que esta cuestión la acabamos de responder con el ejercicio anterior: cuanto más contexto le damos, mejor será la respuesta que nos proporcione. Obviamente, tal como menciono en el libro, hay que encontrar un balance entre cantidad y calidad, pues, como se puede imaginar, nos servirá de muy poco escribir párrafos muy extensos si la información que proporcionamos es irrelevante para la tarea que queremos realizar. Para darse cuenta de ello, no hay mejor manera que, tal como hemos visto en las cuestiones anteriores, experimentar.

P: Antes de lanzarnos en tromba a la tecnología de IA generativa como ChatGPT, ¿conviene pensar si nos hace falta para la tarea que le vamos a preguntar?

R: Totalmente de acuerdo, y es una muy buena apreciación. Yo tengo la siguiente opinión: que tengamos siempre disponible esta tecnología no significa que debamos emplearla para todo. De hecho, creo que es clave cuestionarnos si el uso que le estamos dando a ciertas tareas es realmente necesario. Obviamente, esto varía según la persona.

Por ejemplo, en mi caso, utilizo estas herramientas principalmente para mi trabajo. Para los demás aspectos de mi vida, intento desconectarme bastante de estas tecnologías. Esto no significa que no sean útiles o que no sean necesarias en ciertos contextos; tal y como he mencionado, me resultan muy útiles muchas veces para personalizar ciertas recetas o para establecer una rutina de ejercicios. Simplemente, no tengo la necesidad de emplearlas más allá. En cambio, otra persona las utilizará de manera diferente, ya que le aportan más valor en otros aspectos de su día a día.

En resumen, una de las cosas que nos diferencia de esta tecnología es que tenemos sentido común. Así que, ¿por qué no emplearlo para hacer un uso responsable de ella?

P: Y una vez que ya estamos metidos en el ajo, que nos ahorre labores tediosas y mecánicas es un placer, ¿verdad?, aunque siempre hay que verificar todo por aquello de lo sesgos y los bulos que campan a sus anchas. ¿Esto lo tenemos que hacer siempre?

R: Por buenas prácticas, como bien sabemos, deberíamos hacerlo siempre, al menos según mi criterio. Otra cosa es que esto sea factible. En cualquier caso, el usuario es quien debe valorar el impacto que puede tener el uso de las respuestas que la herramienta genera, en caso de que estas sean erróneas. Por ejemplo, si se equivoca corrigiendo las faltas de ortografía de un texto, probablemente el impacto de este error sea mínimo. En cambio, si la usamos para que nos recomiende la dosis de un medicamento en concreto y se equivoca con dicha dosis, no hay duda de que el impacto sería muy significativo. Aunque, de nuevo, estaríamos entrando en el terreno de cómo y para qué estamos empleando estas herramientas.

P: ¿Cuál de los debates que plantea en la segunda parte del libro le gusta más y por qué?

R: El capítulo que me parece más interesante de la segunda parte del libro es el siguiente: El espejo de la sociedad, ¿podemos deshacernos de nuestros sesgos?, puesto que es en esta sección donde ponemos en práctica lo descrito en la cuestión anterior. Es decir, mediante la interacción con estas herramientas, se evidencia la necesidad de que el usuario mantenga una visión crítica al utilizarlas, ya que la respuesta que genera la herramienta puede no ser acertada.

P: En el manual apela a la responsabilidad de cada uno en el uso de esta herramienta que nos parece útil y desbocada. ¿De qué manera podemos remar hacia estas aguas cuando confiesa que su mayor preocupación es “la invasión de nuestra privacidad individual”?

R: Considero que esta pregunta se responde a sí misma, pues, tal como se señala en el libro, está en nuestro poder decidir cómo empleamos estas herramientas. De aquí surge la necesidad de un uso responsable, ya que, como cualquier tecnología, pueden emplearse tanto para nuestro beneficio como para nuestro perjuicio. Por ello, destaco de manera reiterada la necesidad de ser conscientes de la información que compartimos y de lo que puede hacerse con ella.

P: ¿Por qué advierte del riesgo de “humanizar” el modelo de IA, de tener “la falsa sensación o creencia” de que empatiza con nosotros cuando es solo un modelo que aprende a través de unos datos?

R: Me alegra mucho saber que usted conoce, a grandes rasgos, cómo funciona esta herramienta, pero, desafortunadamente, no siempre es así. Por desgracia, hay ciertos usuarios que emplean estas herramientas y desconocen cómo realmente funcionan y, por ello, cuando interactúan con ellas, caen en la falsa sensación de que están hablando con un humano.

Para comprobar este aspecto, basta con preguntar a una de estas herramientas algo tan simple como lo siguiente: “¿Cómo estás?”. Probablemente te responda que se encuentra muy bien, aunque no experimente emociones. En consecuencia, si desconocemos cómo funciona y es capaz de simular de manera bastante sofisticada el comportamiento humano, es muy probable que establezcamos un vínculo de confianza, lo cual puede conllevar ciertos riesgos asociados como, por ejemplo, tener una mayor predisposición a compartir información personal. De hecho, cada vez hay más personas que califican a estas herramientas como “mi nuevo mejor amigo”. De aquí surge mi necesidad de reiterar el riesgo de “humanizar” a un modelo que aprende a través de datos, aunque, a priori, parezca muy obvio para muchos de nosotros.

P: En este aspecto, ¿la inteligencia aumentada donde el humano está en el centro de todo es la solución?

R: No sé si es la solución definitiva, aunque creo que es la mejor entre todas las disponibles actualmente. Muchas veces hablamos de sustitución cuando nos referimos a la implementación de la inteligencia artificial. Yo soy más partidario de usarla como complemento para potenciar nuestras habilidades y, de ahí, surge el término “inteligencia aumentada”.

P: ¿El Christian de 2035 se asombraría de cómo ha cambiado la IA y la IA generativa en diez años? Apelo a su olfato de investigador: ¿qué podríamos estar usando en diez años?

R: Es una muy buena pregunta y, probablemente, la más difícil de responder para mí. Por la evolución que he observado en los últimos años, no estoy seguro de que vayamos a ver cambios muy significativos, pues todo parece indicar que se están destinando más esfuerzos a aumentar las dimensiones y la complejidad de las arquitecturas de los modelos actuales, en lugar de crear modelos nuevos que sean completamente disruptivos. Como bien sabemos, a nivel de escalabilidad, llegaremos a un punto en el que alcanzaremos un límite debido a las actuales restricciones computacionales. Aquí es, según mi esperanza como investigador, donde comenzaremos a hablar con mayor frecuencia del desarrollo de modelos de inteligencia artificial cuántica, un campo que me presentó el investigador Andrés Bravo, junto con quien estoy actualmente trabajando en ello, a quien estoy muy agradecido.

P: Otro decálogo que asoma en ¿Y si la IA me arregla la vida? es el del buen autocuidador digital donde recomienda a todos leer las políticas de privacidad y uso de datos, que aceptamos sin detenernos, ¿no se siente solo clamando en el desierto?

R: Por suerte o por desgracia, no me preocupa sentirme solo clamando en el desierto en este aspecto. De hecho, siempre que abordo estos temas, he recibido muchos comentarios del estilo “esto ya nos pasa con las redes sociales”, “vaya novedad”, “¿y qué?”. No obstante, al igual que con la humanización de la tecnología, considero que a veces es necesario recordar lo evidente, ya que muchas veces se nos olvida. Aquí es también cuando aflora mi vena docente: con que una sola persona se detenga a valorar críticamente lo que estoy diciendo, eso ya me hace feliz.

P: Sea honesto, ¿a veces se salta algunos de los pasos de su manual?

R: Obviamente, es inevitable. En este libro he intentado exponer ciertos conocimientos que he ido adquiriendo a lo largo de mi experiencia y que considero que pueden resultar relevantes para los demás. Por ejemplo, señalo que uno de los métodos que puede ser muy útil cuando nos estamos iniciando en estos mundos es el del “OCA a OCA y tiro porque me toca”. Esto no significa que deba emplearse para todos los prompts que vayamos a generar. Habrá muchos casos en los que esto no sea necesario y en los que, incluso con una frase mal estructurada, la herramienta sea capaz de generar la respuesta esperada. Aquí es donde el usuario, a su criterio, decide cómo interactuar con estas herramientas en base al conocimiento adquirido.

——–

Pasado ya el toma y daca de las preguntas y las repuestas, a escondidas del entrevistado, le pido lo siguiente a ChatGPT:

Por favor, escribe un párrafo final —como si fueras un periodista eficiente que esté al final de una entrevista a Christian Velasco-Gallego, autor del libro `¿Y si la IA me cambia la vida?´. En este párrafo final debe haber una metáfora.

A los tres segundos aparece este contenido en la pantalla:

Al despedirnos, Christian Velasco-Gallego deja en el aire una idea que resume toda la conversación: la inteligencia artificial no es un huracán que arrase con lo conocido, sino un faro en medio de una noche cambiante. Depende de cada uno decidir si teme su luz o si la utiliza para navegar mejor. Y mientras cierra su libro —ese mapa personal para orientarse en un futuro que ya llegó—, queda claro que su propuesta no es prever el destino, sino enseñarnos a llevar el timón con más conciencia y menos miedo.

No me termina de convencer este cierre, no sé a ustedes qué les parece. Metáfora marinera muy manida y frases hechas, pero lo voy a dejar aquí porque tengo en el horno un prompt a fuego lento que reclama mi atención.

Javier Picos / Fotos: Zaida del Río y J.P.